哎,不知道大家有没有这种感觉,现在的AI虽然火得一塌糊涂,但用起来总觉得差点意思。就像你家里请了个特聪明的保姆,但她只会站那听你指挥,你推一下她才动一下。你说“关灯”,她就去关灯;你说“煮饭”,她才去煮饭。少了点啥?少了点眼力见儿,也就是那种“主动帮你把事儿办了”的机灵劲儿。

这事儿吧,其实不赖那些开发大模型的程序员哥哥,根子可能出在我们手机或者电脑里头的那块小硅片上。我以前也觉得,芯片嘛,不就是沙子做的脑袋,越快越好呗。但最近跟一个在中芯国际干了好几年的老同学撸串,他一句话点醒了我:“现在的芯片,就像个只会算数的账房先生,但你让他去管个铺子,他就抓瞎了。”

这就引出了咱们今天要聊的主角——你可能听得耳朵起茧,但真没几个人讲明白的 AI代理芯片。

这玩意儿到底是个啥“妖怪”?

咱就别整那些“存内计算”、“并行架构”的术语了,说了也记不住。你就把它想象成一个特别会“来事儿”的贴心小秘书。

咱们以前的电脑芯片,包括那些厉害的显卡,它们擅长的是“照章办事”。你给一套公式,它算得飞快,像那种特听话的实习生,你不把话说到位,他就不知道下一步干啥。但AI代理芯片这玩意儿,它内置了一套“人情世故”的逻辑。

我这么一说你可能觉得玄乎。我举个例子,英伟达的老黄前段时间不是放话嘛,说“AI代理的ChatGPT时刻已经来临” -7。这话啥意思?就是说以后AI不光是生成个文字、画个图,它得自己去执行任务。比如你跟手机说:“帮我订一家周五晚上俩人吃饭、能看江景、别太辣的馆子。”以前的AI会给你搜一堆结果,你自己挑。但有了AI代理芯片的设备,它会自己调出你的历史口味,避开上次你给差评的那家,再根据实时交通选个不堵车的地儿,然后直接在你手机日历上建个提醒,甚至问问你需不需要顺便叫个代驾。

这一连串的动作,如果都传到云端去算,再传回来,黄瓜菜都凉了。这就得靠咱们手里的终端设备自己“拿主意”,而拿主意的这个“脑子”,就是AI代理芯片干的活儿 -10。

别光听概念,咱得看疗效

你说这芯片升级,对咱普通人有啥好处?好处太大了!我前两天看一个报告,说现在的AI推理成本降得厉害,执行GPT-3.5级别的系统推理成本在2022年11月至2024年10月间骤降了280多倍 -1。凭啥降这么多?就是因为这种专用的推理芯片开始发力了。

以前咱们跑个大模型,得靠云端那一排排烧电的老虎机(GPU),现在不一样了。像高通、联发科,甚至咱们国内的爱芯元智,都在搞这种专用芯片。特别是那个边缘计算和端侧推理,市场大的吓人,预测到2030年,光是边缘推理全球市场规模就能到7262亿元,端侧更是能到8861亿元 -1。

这不光是数字,这意味着啥?意味着以后你的智能音箱不再是“人工智障”。我家那口子买了个智能音箱,喊它八遍才应一声,应了还经常听岔。但如果用上AI代理芯片,它能本地就处理你的语音,降噪、理解、决策,都在音箱里自己搞定,又快又准,还不用担心隐私泄露——毕竟你的那些家长里短,不用再传到不知在哪的云端服务器里了 -5。

这赛道卷成啥样了?

现在这帮做芯片的,卷得那叫一个厉害。思科那边连3纳米的网络芯片都搞出来了,专门给AI集群之间传数据用,带宽一百多T,就是为了不让数据堵车 -6。而像SambaNova这家公司,刚发布了个SN50芯片,号称跑代理AI的成本比英伟达的GPU低三倍,速度快五倍 -4。这就有点意思了,摆明了是要在老黄的碗里扒拉饭吃。

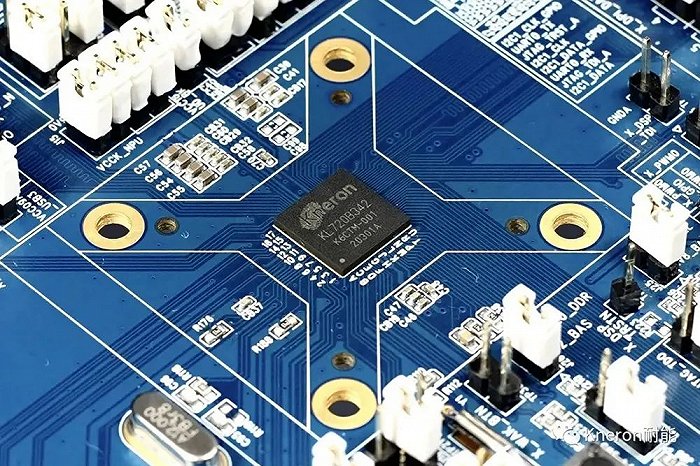

更别提咱们国内的爱芯元智,人家现在都港股上市了,成了“中国边缘AI芯片第一股” -1。它的芯片有个好处,就是特别懂“看脸色”。比如在智能驾驶里,能一边看清路面,一边低功耗运行,还能保证反应速度。他们那个NPU,据说是用了一种混合精度的“抠门”计算法,该省电的地方绝不多费一度电,该精细的地方绝不含糊,能效比传统方案提升了足足10倍 -1。

这就像咱们过日子,该花的花,该省的省。以前的GPU是“土豪”,干啥都大手大脚;现在的AI代理芯片,成了“精明的管家”,每一分电、每一毫秒都要花在刀刃上。

未来的日子,想想都带劲

我这人比较懒,所以特别喜欢这种能“替我操心”的技术进步。你想啊,以后你的电脑里可能住着一个真正的AI代理。它看着你在写周报,发现你卡壳了,就主动调出上周的项目数据,帮你总结出三条亮点;你晚上加班,它根据你心率监测发现你有点疲惫,自动把办公室灯光调暖,帮你点杯温热的枸杞茶 -10。

这种体验,靠的不是更大更猛的云端算力,而是你手头这台设备里那颗越来越懂事的AI代理芯片。它让AI从天上飘着的“神仙”,变成了你身边贴心的“伙伴”。

当然,也有人担心,这玩意儿太聪明了,会不会有安全问题?之前OpenAI不就发报告说,有些诈骗分子开始利用AI生成那种情感操纵的信息,甚至冒充律师行骗 -7。这就好比菜刀能切菜也能伤人,关键还得看拿刀的手。但不可否认,技术这趟车,一旦开起来就停不下来了。

我寻思着,再过个两三年,咱们再回头看现在的手机电脑,可能就跟看当年的功能机一样,觉得它们“笨得要死”。而让它们开窍的,正是这些藏在角落里的,咱们平时看不见也摸不着的AI代理芯片。

网友评论区互动:

1、网友“江南皮革厂小开”问:

“博主说得天花乱坠,我就关心这玩意儿啥时候能用上?我去年刚买的iPhone 16 Pro Max,能不能也通过系统升级变出这种AI代理芯片的功能来?”

回答:

哎呀,这位老板一看就是不差钱的主儿。不过这事儿我得给您泼盆冷水,这还真不是光靠系统升级就能搞定的。您可以把AI代理芯片想象成一个厨子,系统升级最多是换菜谱。您以前的手机里那个“厨子”(芯片)是个做快餐的,手快但不会炒大菜;现在的AI代理芯片是个专门研究过分子料理的大厨。您非让那个快餐厨子照着米其林三星的菜谱做,他就算把菜谱背得滚瓜烂熟,做出来的玩意儿那味儿能对吗?

具体啥时候能用上,得看这“厨子”啥时候进您手机。像高通的骁龙平台、联发科的天玑,新一代的旗舰芯片已经在往这个方向猛攻了,像那个能跑到80 TOPS算力的NPU,就是干这个活的 -10。我估摸着,明年下半年到后年,新出的旗舰机应该就能把这功能当成主打卖点了。您那16 Pro Max,性能还是杠杠的,但要说让AI自己“来事儿”,可能真得等硬件换代。您再忍忍,让它发挥余热,到时候直接一步到位换那个真“智能”机!

2、网友“深海里的鱼”问:

“我就担心隐私!以前AI在云端,我觉得是把自己家底儿都交给别人了。现在你说这芯片在本地就能自己决策,那我的数据是不是就安全了?会不会更危险,因为设备丢了,里面那个‘小秘书’就把我全卖了?”

回答:

哎哟,您这问到点子上了,也是现在好多工程师秃头解决的问题。您说得对,以前是“裸奔”上云,现在更像是把数据锁在自己家的保险柜里。

本地处理确实解决了一大半隐私问题。因为数据根本不用出设备,什么起床时间、银行余额、跟老婆的聊天记录,统统烂在手机里,那些大公司想偷摸收集拿去训练模型都拿不到了 -5。这就像安提国际他们搞的那种企业级方案,老板看财报数据,根本不敢上云,就得在自己公司机房里的边缘工作站处理,图啥?就图个“数据主权”在自己手里 -2。

但您担心的设备丢失问题,确实存在。不过您也别太焦虑,现在的安全机制也在升级。以后这些AI代理芯片本身就会带一个独立的“安全区”(就像个带锁的密室),专门存放您的隐私数据。就算贼偷了您手机,他也打不开这间密室,而且这密室里的数据跟外面的普通数据是物理隔离的。再加上指纹、人脸这些生物识别,那个AI小秘书在确认不是您本人之后,大概率会直接装死或者自毁资料。所以,它卖你?大概率是你卖它。技术总是在道高一尺魔高一丈中进步的嘛。

3、网友“风吹麦浪”问:

“博主,你一直说这芯片让AI自己干活,那我干啥?我岂不是更没用了?这会不会导致大面积失业啊?现在工作本来就难找,以后AI连‘思考’都替我做了,人存在的价值是啥?”

回答:

兄弟,你这问题有点哲学,但也确实是咱们这代人必须面对的焦虑。我给你讲个我自己的糗事吧。前阵子我用了那个很火的AI编程工具,心想这下爽了,摸鱼神器啊。结果呢?代码它确实给我生成了,但跑起来一堆bug,我因为看不懂它生成的逻辑,改bug花的时间比我自个儿写还长。从那以后我悟了:AI不是替代我,是把我往上“架”了一层。

以前我们是“执行者”,自己动手写代码、做报表、订餐厅。以后AI代理芯片把我们解放出来了,让我们变成了“管理者”和“决策者” -2。就像那个安提展示的“CXO Solution”,给CEO用的,AI把数据都整理好了,风险也分析了,最后拍板的是谁?还是那个CEO -2。

人会干啥?人会看眼色,会拍马屁(虽然这不好),会凭直觉赌一把,会在谈判桌上因为对方一个皱眉就调整策略。这些带着“烟火气”和“江湖气”的决策,基于冰冷数据和逻辑的AI,短时间还真学不会。所以,未来可能很多重复性的脑力工作会被取代,但懂得怎么“用”AI、怎么给AI下指令、怎么判断AI给的答案对不对的人,会越来越值钱。 咱别跟AI比算账,咱得比它更懂“人事儿”。您说是不?