大家好啊,作为一个在测试圈摸爬滚打了快八年的老油条,这半年我是真真切切体会到了啥叫“一夜回到解放前”。为啥?因为AI代理(Agent)这玩意儿火起来了,老板大手一挥,所有产品必须接入智能体,测试那边给我顶住,保证质量。

顶住?拿啥顶?咱以前那套“录制-回放”的功夫,在AI代理面前就跟纸糊的一样。你跟AI说“帮我查下明天天气”,它可能去调API,可能去翻网页,甚至可能跟你唠两句“带伞了吗”。这种概率性输出搞得我那段时间神经衰弱,做梦都是断言失败的红灯 -2。今天就把我这半年来参加无数场AI代理测试策略讨论会、踩坑踩出来的经验,跟大伙儿掏心窝子聊聊,全是干货,没那些虚头巴脑的。

咱得先搞明白,这玩意儿到底“神”在哪儿,又“神经”在哪儿

以前咱们测个登录框,输入密码,点登录,要么成功要么失败,非黑即白。但AI代理不是啊,它是个有“脑子”的,虽然这脑子有时候也进水。我印象最深的一次AI代理测试策略讨论会上,一个哥们儿拍桌子说:“这玩意儿跟小孩儿一样,你不能只盯着他这次考试及格没,你得看他学习过程对不对!”

这话点醒了我。现在的AI代理,尤其是像GLM-5或者那些能写代码的智能体,它们的核心是多步决策 -1。比如让它订个机票,它得先理解需求,然后去,比价,选座,最后支付。任何一个环节掉链子,比如把“经济舱”理解成“头等舱”,那后面全完蛋。所以咱们的测试对象,从代码逻辑变成了行为轨迹 -1。哎呀妈呀,这就不是光靠写几条断言脚本能搞定的事儿了。

别迷信那些“一键生成”,“脑部扫描”比“体检报告”更管用

现在市面上出了好多AI测试工具,什么Testin XAgent,还有MetaGPT那套 -8-10。有些老板一看,嚯,AI自己测自己,牛逼啊,买!结果买回来发现,生成的用例是挺多,但都是些“正确的废话”。

咱得区分开来看。像Docker出的那个Cagent,它的思路是确定性重放 -2。啥意思?就是先把AI跟外界的交互(比如调的API、查的数据库)录下来,以后每次测试都照着这个剧本演,不许AI自由发挥。这招在回归测试里贼好用,能保证核心流程不走样。

但这就够了吗?不够。因为AI代理真正的灵魂是“随机应变”。你录个剧本,人家用户换了个说法,它就懵了。所以还得有动态测试 -6。这就像咱不光要测它的“肌肉记忆”,还得测它的“脑子反应”。

怎么测?LambdaTest提出了一个特别损的招儿——代理到代理测试 -5。就是弄一个专门挑刺的“坏蛋AI”,去跟咱家那个“老实AI”聊天。坏蛋AI专门用各种奇葩话术、方言、甚至带歧义的问题去撩骚,看老实AI会不会被带沟里去。比如在测客服智能体的时候,我们就设计了一个“杠精”AI代理,专门找茬。一开始,我们那老实AI差点跟用户吵起来,后来调了十几版才好点。这种压力测试,测的不是并发量,是认知稳定性 -3。

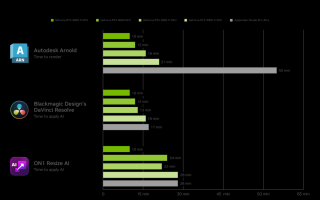

性能测试那点事儿:以前看并发,现在看“脑瓜仁儿”疼不疼

说到性能,这也是个新课题。以前测性能,咱们关注啥?TPS、响应时间、CPU占用。现在测AI代理,这些都得看,但远远不够。

我给大伙儿说个真事儿。有次我们上线一个AI文档助手,上线前压测,200个并发稳稳的。结果上线第二天,直接卡成狗。后来一查,问题出在上下文积累 -3。用户不是只问一句话,而是跟AI唠了十几分钟,每个人的上下文窗口都塞得满满的。每个请求的Token数爆炸,GPU计算量指数级增长。

所以现在咱们做负载测试,得模拟这种“长对话”场景。不能上来就测1000个新会话,而要看100个深度会话对系统的冲击。这就好比一个人跑100米短跑和跑10公里马拉松,身体消耗完全不是一个量级。我们管这叫延迟弹性测试 -3——看看随着会话变长,你的响应时间是不是也跟着“变胖”了。

而且,还得盯着成本。现在很多AI按Token收费,负载一高,如果代码没优化,那烧钱的速度比烧纸还快 -3。有一次我们压测发现,虽然响应时间还行,但每笔请求花的Token钱多了一倍。结果是因为代理在循环里反复调用一个工具,逻辑出bug了。性能测试不只看快慢,还看智商税交得值不值。

那些年,我们一起追过的“评估标准”

最后说说这个老大难问题——通过标准。这玩意儿太玄学了。有时候AI答得挺溜,但全是废话;有时候吞吞吐吐,但最后把事儿办了。咋评?

Elastic的做法我觉得挺靠谱,他们整了个多维度的“体检表” -4。比如测客服代理,不仅要看精确率和召回率(是不是答非所问),还得看事实性(有没有瞎编乱造),甚至看攻击链一致性(安全场景下,有没有被绕过去)。咱们现在也学乖了,引入了一个“LLM-as-judge”,就是让一个更高级的AI当裁判,给被测AI的回答打分 -4。虽然有点“让裁判下场踢球”的嫌疑,但总比人工一条条看快多了。

不过,也别太迷信AI裁判。我们在做回归测试的时候,还是保留了一套静态测试集 -6,专门挑那些最容易出幺蛾子的“黄金流程”,比如支付、注销账号这种,必须严格按照剧本走,一点错都不能出。

反正折腾了这大半年,我算是明白了,测试AI代理,咱不能再用那套非黑即白的老黄历了。它更像是在驯服一匹烈马,既要它听话(确定性),又要它有灵性(随机应变)。AI代理测试策略讨论这个话题,估计还得吵吵好一阵子。但不管咋变,咱们QA的角色没变,以前是质量守门员,现在是智能体驯兽师,反正都是操心的命!

网友问答互动:

网友“测试界的小菜鸡”问:

大佬,看了你的文章深有感触。我们团队也想引入AI代理,但现在最头疼的是,这玩意儿输出不稳定,自动化用例天天报错,开发都麻了。到底应该先测啥?有没有一个优先级?比如是先把核心业务流程测稳定了,还是先把那些天马行空的边缘情况覆盖了?

答: 嘿,兄弟,你这问题问到点子上了!我当初也是一脑门子包。听哥一句劝,千万别想着撒大网捞小鱼。咱们得分步骤来,就跟打游戏推塔一样,得一步一步推。

第一步,先推水晶,也就是你的核心业务流。比如电商的“加购-支付-出单”,金融的“登录-核身-转账”。这些场景必须用Docker Cagent那种确定性测试思路,把交互录下来,死死锁住 -2。就算天塌下来,这条线不能断。这能保住你的底裤,不对,是保住产品的底线。

第二步,再推高地塔,也就是那些高频但有一定变通的场景。比如客服的“查订单-催单-退换货”。这时候可以上动态测试,允许AI自由发挥一点,但得盯着它的成功率和意图识别准确率 -4。只要它别把“催单”理解成“骂人”就行。

才去野区抓人,也就是那些极端边缘情况。这时候就放出LambdaTest那种“杠精AI”去撩骚,看看你家的代理会不会精神崩溃 -5。千万别一上来就挑战地狱难度,否则开发会提着键盘来找你的。先保命(核心流程),再谈生活(花式交互)。

网友“只想躺平的QA”问:

我们现在用的是Selenium那一套,脚本维护成本高得吓人。最近在看那些AI测试工具,像RealDevWorld或者XAgent,说是能自愈脚本,真的假的?有没有坑?是不是买了就能躺平了?

答: 哎呀,关于“躺平”这俩字,我劝你趁早忘了它(笑)。这些AI工具确实牛,但还没到让你彻底养老的地步。

你说的自愈脚本,这功能是真的有,但不是魔法。它的原理是用视觉大模型去“看”页面,而不是像以前那样傻傻地找XPath -8-9。比如你有个登录按钮,以前XPath是//div[1]/button[2],开发手贱挪了个位置,脚本就崩了。现在AI工具通过OCR或者视觉识别,能认出“哦,这个长方形上面写着‘登录’俩字,就是那个该死的按钮”,所以它依然能点到。这确实能省下至少60%的维护功夫 -9。

但坑在哪儿呢?坑在于这玩意儿有点“认死理”。如果你们产品的UI风格大改版,把“登录”图标从方形改成了圆形,颜色从红变绿,而且去掉了文字,那AI也得懵,因为它没见过这世面。这时候就需要你喂数据给它,告诉它“宝贝儿,这新皮肤也是登录按钮”。

所以,买了工具不是让你躺平,是让你从“搬砖工”升级成了“包工头”。你不需要亲自搬砖了,但你得指挥AI往哪儿搬,搬多少。省下来的精力,多去研究研究业务逻辑和用户体验,这才是QA未来的护城河 -8-10。

网友“头秃的开发组长”问:

性能测试那个点我感触很深,现在AI代理一上,服务器成本噌噌涨。作为开发负责人,我怎么在项目初期就预估这个系统的负载能力?总不能每次上线前才压测,发现不行又得紧急扩容,太被动了。

答: 哥们儿,你这已经不是测试思维了,这是运维架构思维了,赞一个!你说的这事儿,我管它叫“成本前置预测”。

在项目初期,还没写几行代码的时候,咱确实没法精确压测,但可以估算模型的“脑容量”。

你得搞清楚你的代理是干啥的。如果是简单的Q&A问答,那负载模型相对简单,主要看单次推理延迟。但如果是有多轮对话、有工具调用的任务型代理,那就得复杂点。

我建议你在设计阶段就做一个小范围的“认知负载仿真”。啥意思?就是用脚本模拟一小批用户,比如10个,让每个用户跟AI唠20轮。然后盯着GPU的显存变化和推理队列的长度 -3。看看AI是不是像吃了安眠药一样,聊到第10轮就反应迟钝了。

通过这种小规模测试,你可以画出一条“延迟-会话深度”曲线。如果这条曲线在第15轮之后陡然上升,像个拐棍似的,那你就知道了:系统最多只能承载15轮的深度会话。

有了这个数据,你就能反推回去:假设一个用户平均聊10轮,那你的并发用户数上限是多少。再结合业务预测的用户量,你就能在项目初期大概算出需要多少卡,成本预算是多少。这比上线前才发现崩了,要体面得多。记住,AI的性能拐点不是线性的,它往往像个隐藏的地雷,你得提前把它挖出来 -3。